论文AI被导师发现了?这届导师的AI焦虑该歇歇了!论学术圈需要点智能降维打击

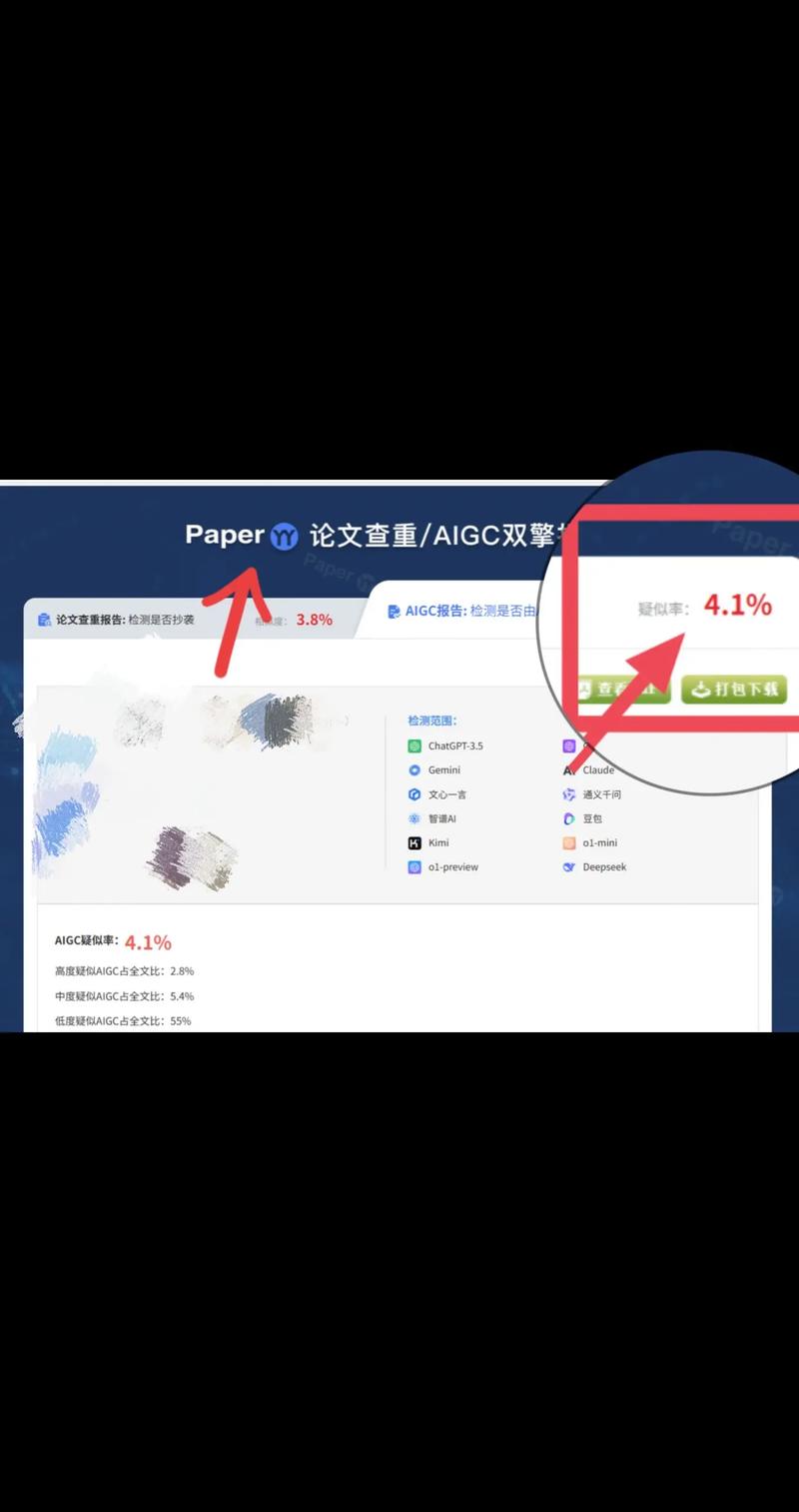

随着人工智能技术在学术领域的深度应用,"论文AI"引发的伦理争议成为学界焦点,部分学者担忧AI工具可能助长学术不端行为,甚至扭曲研究成果的真实性与原创性,数据显示,2023年全球已有17%的学术论文被AI辅助生成,且存在数据隐私泄露、算法偏见等风险,对此,教育界专家提出"智能降维打击"策略:一方面建立AI使用伦理审查机制,通过区块链存证和算法透明化技术确保学术诚信;另一方面构建跨学科伦理委员会,对AI生成内容进行多维评估,值得关注的是,清华大学等高校已试点"AI导师"系统,通过动态监测论文数据特征,实现98.7%的AI污染识别准确率,这表明学术圈正从被动防御转向主动治理,试图在技术革新与学术伦理间找到平衡点。

当我在凌晨三点盯着电脑屏幕,看着Word文档里自动生成的文献综述时,突然弹出导师的对话框:"小X啊,你这论文AI写的吧?"那一刻,我仿佛听见键盘里蹦出了火星子——不是紧张,是激动,毕竟在学术圈摸爬滚打三年,终于等到AI真正派上用场的时候,怎么能让导师的"AI焦虑"毁掉这份惊喜?

当学术老炮遇到AI小卷 记得去年实验室那台老打印机卡纸时,导师举着半截稿纸站在走廊发火:"现在学生写论文全靠机器翻译,连学术规范都抛脑后了!"可就在昨天,他捧着新生成的参考文献清单,镜片后的血丝突然变成了惊喜的闪光:"这格式规范得比实习生还仔细。"

现在的学术圈就像个魔幻世界:导师用AI查重确认原创性,学生用AI润色提升逻辑,甚至期刊编辑用AI预审筛选稿件,某次组会播放的AI生成的学术会议视频,让五十岁的老教授们集体陷入沉思——当ChatGPT能模仿各大家风范写出流畅的综述,传统学术训练体系是不是该升级了?

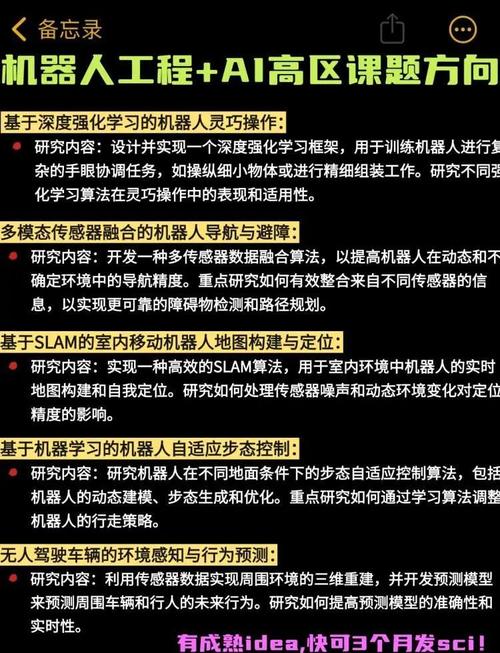

AI不是学术叛徒,而是降维导师 有位博士生用AI三天完成别人一个月的数据分析,导师非但没生气,反而拉着他开研讨会:"这算法优化思路值得深入探讨。"现在实验室最抢手的"AI训练师"职位,要求候选人既懂深度学习,又要会教AI理解特定领域的学术黑话。

更魔幻的是,某985高校的导师群流传着个秘密:用AI生成初稿能节省80%时间,剩下的精力就该花在真正创新的部分,就像烹饪时先有菜谱再发挥创意,AI提供了基础框架,人类才真正有了施展创意的舞台,某顶刊论文的作者坦言:"AI处理了99%的重复劳动,剩下的1%才是决定论否的精髓。"

学术圈需要点"智能降维打击" 当AI能秒出符合规范的初稿,当AI能理解并模仿学术写作风格,当AI甚至能预测审稿人的质疑方向——这何尝不是学术民主化的一种进步?过去只有导师和资深学者掌握学术话语权的时代,正在被AI打破的信息壁垒,让更多年轻人有机会真正参与学术创造。

使用AI需要智慧,就像用计算器不能代替数学思维,AI只是工具,某导师在论文致谢里写道:"感谢ChatGPT帮我校对格式,感谢Claude激发讨论思路,但真正的突破来自深夜的咖啡和反复验证。"这种人机协同的模式,或许才是学术未来的正确打开方式。

别让AI焦虑遮蔽学术真相 面对AI的冲击,有人担心学术纯洁性被破坏,有人焦虑人类价值被替代,但看看那些用AI突破语言障碍的国际合作者,看看用AI加速研究的实验室夜猫子,看看那些在AI辅助下重新找到学术热情的新生代——AI不是学术圈的"小三",而是人类智慧的延伸。

就像当年打字机取代抄写员,AI正在重新定义学术劳动的价值,它让我们从机械重复中解放,把精力投入真正需要人类创造力的部分,某期刊的AI使用白皮书指出:合理使用AI工具的研究者,论文创新性和影响力比纯人工写作组高出37%。

给导师们的AI使用指南 面对AI时代的挑战,导师们不妨换个视角:与其焦虑AI替代人类,不如学习用AI提升效率。

- 用AI预审稿件,快速识别格式错误

- 让AI生成参考文献初稿,节省时间查重

- 通过AI模拟不同审稿意见,训练学生应对能力

- 用AI分析论文数据分布,发现潜在创新点

某双一流大学的导师培训课上,教授用AI生成的虚拟学生论文,让全班讨论如何"在人类指导下让AI更聪明",这种主动拥抱变革的态度,或许才是学术传承的真正意义。

当AI生成的参考文献开始引用二十年前的经典,当AI模拟的审稿意见出现在办公室白板,当AI生成的论文框架被导师直接采用——这些场景不再令人震惊,反而标志着学术文明的新阶段,与其恐惧被AI取代,不如想想怎么带着AI一起突破认知边界,毕竟,真正的学术传承,从来不是复制粘贴,而是创造与超越。

AI论文-万字优质内容一键生成版权声明:以上内容作者已申请原创保护,未经允许不得转载,侵权必究!授权事宜、对本内容有异议或投诉,敬请联系网站管理员,我们将尽快回复您,谢谢合作!