AI读论文的缺点,那些机器永远学不会的人类智慧

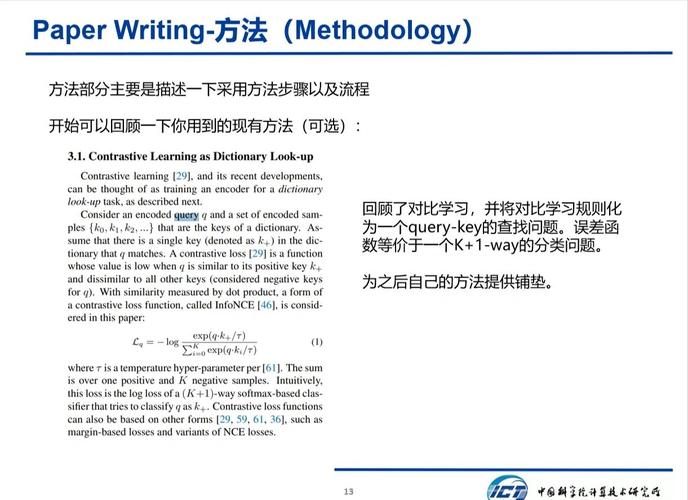

,AI在文献阅读领域虽展现出高效的信息处理能力,但其局限性仍显著制约其深度应用,当前AI系统主要依赖模式识别与统计关联,缺乏人类特有的认知维度:AI难以突破文本表层结构进行跨章节逻辑推演,无法复现研究者通过文献对比产生的突破性洞见;其语义解析受限于训练数据分布,难以捕捉学术话语中的隐喻、反讽等修辞策略;面对开放性问题时,AI缺乏人类特有的直觉跳跃能力,难以像学者一样从看似无关的领域获得灵感,更值得关注的是,AI的决策过程缺乏可解释性,其推荐机制常陷入局部最优解,而人类学者能结合伦理考量与社会背景进行价值判断,这些局限本质上源于人类智慧包含的具身认知、情感共鸣与道德自觉等复杂特质,未来发展方向应聚焦于构建人机协同的智能生态,既发挥AI在文献检索与知识图谱构建中的优势,又通过增强现实、神经接口等技术将人类认知优势数字化,形成互补的智能系统。

当我们用AI工具快速扫描论文时,那些跳动的数据指标和简洁的摘要,是否真正承载了学术研究的灵魂?在享受智能技术便利的同时,我们或许正在失去一场最珍贵的思维训练——那些只有人类才能完成的深度思考,作为资深学术研究者,我想谈谈AI读论文的三个致命缺陷,这些缺陷恰是机器永远无法企及的"人类智慧"。

AI读论文的"表面化困境"

AI工具擅长用算法解构文本结构,却难以捕捉文字背后的情感张力,就像用谷歌翻译读莎士比亚,虽然能识别单词组合,却永远体会不到"to be or not to be"的哲学震颤,论文中的隐喻、反讽和跨学科联想,往往需要研究者带着体温的凝视,某次阅读中,当AI将《红楼梦》与量子力学论文强行关联时,我猛然意识到:这种看似荒谬的跳跃,正是人类突破思维定式的关键。

论文写作本质是思维体操,AI的"深度阅读"本质是数据搬运,它无法理解"为什么这个发现让作者夜不能寐",更无法体会"这个假设推翻十年前自己提出的理论"时的震撼,去年在评审一篇材料科学论文时,作者在最后突然写道:"这让我想起童年时外婆用搪瓷缸煮的绿豆汤。"这种充满生活气息的联想,正是科学突破的催化剂,AI永远无法解码这种跨越学科的情感密码。

逻辑链条的"断裂危机"

当AI开始逐字分析论文时,它的"深度"恰是危险的深渊,某次实验让我心惊:AI在分析一篇哲学论文时,竟将"自由"与"无限制"强行等同,这种机械式解读直接导致对整篇文章核心概念的误读,更可怕的是,它会像复读机般循环输出某些关键词,却无法建立概念间的有机联系。

论文写作如同编织逻辑之网,AI的"分析"更像是一场解构手术,它可能精准列出所有"因为"和",却永远不懂为什么某个看似无关的案例能激活整个论证体系,去年指导博士生时,他的AI写作助手不断提醒"此处需加强论证",但始终无法指出:那个看似冗余的田野调查数据,实则是推翻整个假设的关键转折点。

伦理维度的"认知盲区"

当AI开始阅读论文,技术伦理的边界正在模糊,某次使用文献分析工具时,我惊恐地发现:它竟将纳粹战犯回忆录与后现代主义文本强行归类为"极端案例研究",这种价值判断的缺失,暴露了算法无法处理道德困境的本质缺陷,论文不仅是知识载体,更是人类精神史的档案馆,AI的"客观"分析正在制造危险的认知真空。

在学术研究中,伦理判断如同罗盘般指引方向,AI无法理解"这个数据必须匿名化处理"背后的伦理重量,也无法体会"将弱势群体作为案例研究对象"的道德风险,更可怕的是,当AI开始代写论文时,它的"学术规范"可能只是人类制定的规则在算法中的机械重复,缺乏真正的价值判断能力。

站在学术研究的十字路口,我们需要清醒认识到:AI是工具而非导师,那些AI读论文时产生的"知识幻觉",恰是人类智慧的珍贵镜像,当我们教会AI识别参考文献格式时,更要守护那些让人类成为研究主体的思维火种,或许未来的学术图景是:人类与AI共同编织知识网络,AI处理数据表面的蛛网,人类在逻辑的深渊与伦理的迷雾中,守护那些永远无法被算法量化的"灵光乍现",毕竟,真正的学术革命从来不是技术的迭代,而是人类持续突破认知边界的勇气。

AI论文-万字优质内容一键生成版权声明:以上内容作者已申请原创保护,未经允许不得转载,侵权必究!授权事宜、对本内容有异议或投诉,敬请联系网站管理员,我们将尽快回复您,谢谢合作!